文/張杰倫

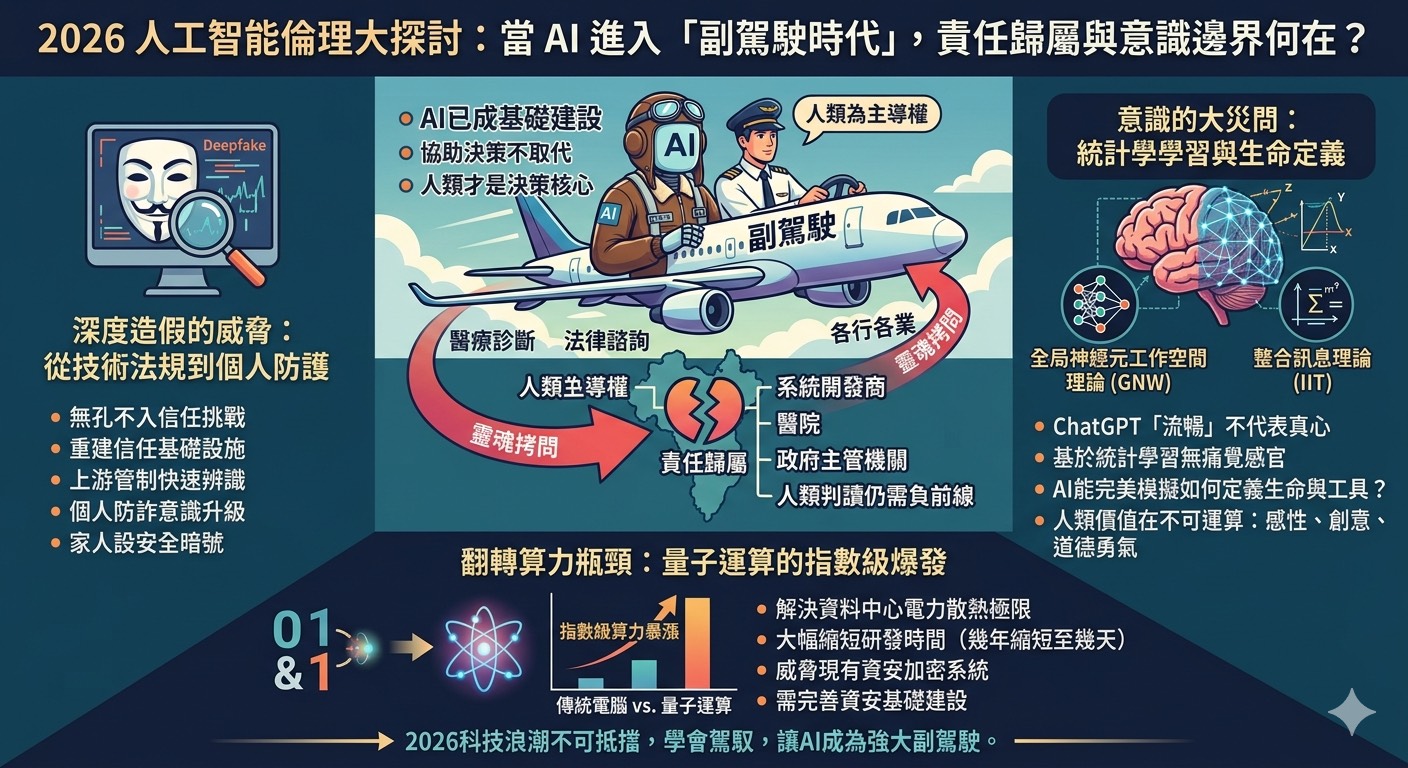

2026 年,人工智能(AI)已不再只是科技巨頭的實驗室玩物,而是轉化為各行各業的基礎建設。當我們正式步入「副駕駛時代」,AI 協助醫療診斷、法律諮詢、甚至搶救人命的決策。然而,隨之而來的「靈魂拷問」也愈發急迫:如果 AI 犯了錯,責任算誰的?AI 是否真的具備意識?在算力極限面前,量子運算又是如何翻轉底層邏輯?

關鍵領域的出錯風險:人類仍是最終決策者

在醫療或法律等關鍵領域,AI 的介入已如火如荼。設想一個情境:當醫院的 AI 總機處理預約是便利,但若是病床旁的 AI 決定如何搶救生命,而最終導致醫療疏失,責任歸屬應如何劃分?

根據目前法律界的共識,AI 並非具備人格的「行為人」,無法承擔法律責任。責任歸屬通常需依實際情況由系統開發商、醫院、甚至政府主管機關共同分擔。然而,科技專家一致呼籲,第一線的專業人員(如醫護、律師)仍需負責最終判讀,並具備拒絕錯誤指令的能力。AI 僅是工具,人類才是決策核心。企業若為降低成本而過度依賴 AI,極易發生「判斷力外包」的危機。最理想的協作模式是讓 AI 處理耗時的繁瑣事務,而將人類的精力保留在「定義問題」與「價值判斷」上。

深度造假的威脅:從技術法規到個人防護

隨著深度偽造(Deepfake)技術無孔不入,2026 年的社會面臨嚴峻的信任挑戰。專家指出,重建信任不能單靠事後查核,必須建立「信任基礎設施」。這包括從上游管制作起,建立快速辨識機制,並要求應用程式商店、支付系統及社群平台共同防堵造假內容的擴散。在個人層面,防詐意識也需「升級」,例如家人間設定專屬的安全暗號,以應對日益精密的影音造假技術。

意識的大災問:統計學學習與生命定義

AI 真的知道自己在說什麼嗎?當 ChatGPT 能流暢地說出「謝謝」或「對不起」,它是真心的嗎?

目前神經科學界對意識的探討主要集中在兩大理論:其一是「全局神經元工作空間理論(GNW)」,其二則是近年備受關注的「整合訊息理論(IIT)」。IIT 理論嘗試用數學計算意識特徵,認為意識源於大腦後端的訊息整合。然而,目前的 AI 本質上仍是基於邏輯運算與統計學習,缺乏生物神經系統來感受痛覺或情緒。AI 的悲傷與喜悅來自對大量文本的學習,而非真實的情感體驗。這引發了更深層的哲學思考:當 AI 能完美模擬人類行為時,我們該如何重新定義「生命」與「工具」?

翻轉算力瓶頸:量子運算的指數級爆發

隨著 AI 模型規模呈爆炸式成長,資料中心的電力與散熱需求已達物理極限。光是 ChatGPT 每天處理的全球查詢,耗電量就相當於 10 萬個美籍家庭。此時,量子運算的出現正逢其時。

量子運算從底層翻轉了傳統電腦「0 與 1」的運算邏輯,透過量子位元的「疊加」特性,算力得以呈指數級爆發。這不僅解決了電力與散熱問題,更能大幅縮短材料科學與生技醫藥的研發時間,將原本需耗費數年的試錯過程縮短至幾天內完成。同時,量子時代也威脅著現有的網路加密系統,資安基礎建設的改善已刻不容緩。

2026 年的科技浪潮不可抵擋。我們必須學會如何駕馭 AI,讓它成為強大的副駕駛,而非取代人類的主導權。在這個數據與倫理交織的新時代,人類的價值將體現在那些 AI 無法運算的——感性、創意與道德勇氣之中。