文/張杰倫

想像一下,你剛為公司聘請了一位頂尖名校畢業的天才助理,他在面試時應答如流、邏輯測驗拿了滿分。然而,當他第一天正式上工,你要求他按照公司的 SOP 處理文件,或遇到困難時去查詢內部資料庫,他卻完全不理會你的指示,甚至自顧自地亂做一通。這種讓人崩潰的情境,正是目前第一線 AI 開發者在面對 Google 最新語言模型 Gemma 4 時最真實的寫照。

最近在知名的開發者論壇 LocalLLaMA 上,關於 Gemma 4 的討論熱度居高不下。作為一名長期追蹤人工智慧發展的科技記者,我觀察到開發者對這款模型的評價呈現極端的「兩極化」:一派將其捧為開源界的神作,另一派則氣到跳腳,直指它是個不聽指令的「雷包」。究竟這款具備頂尖跑分實力的模型發生了什麼事?

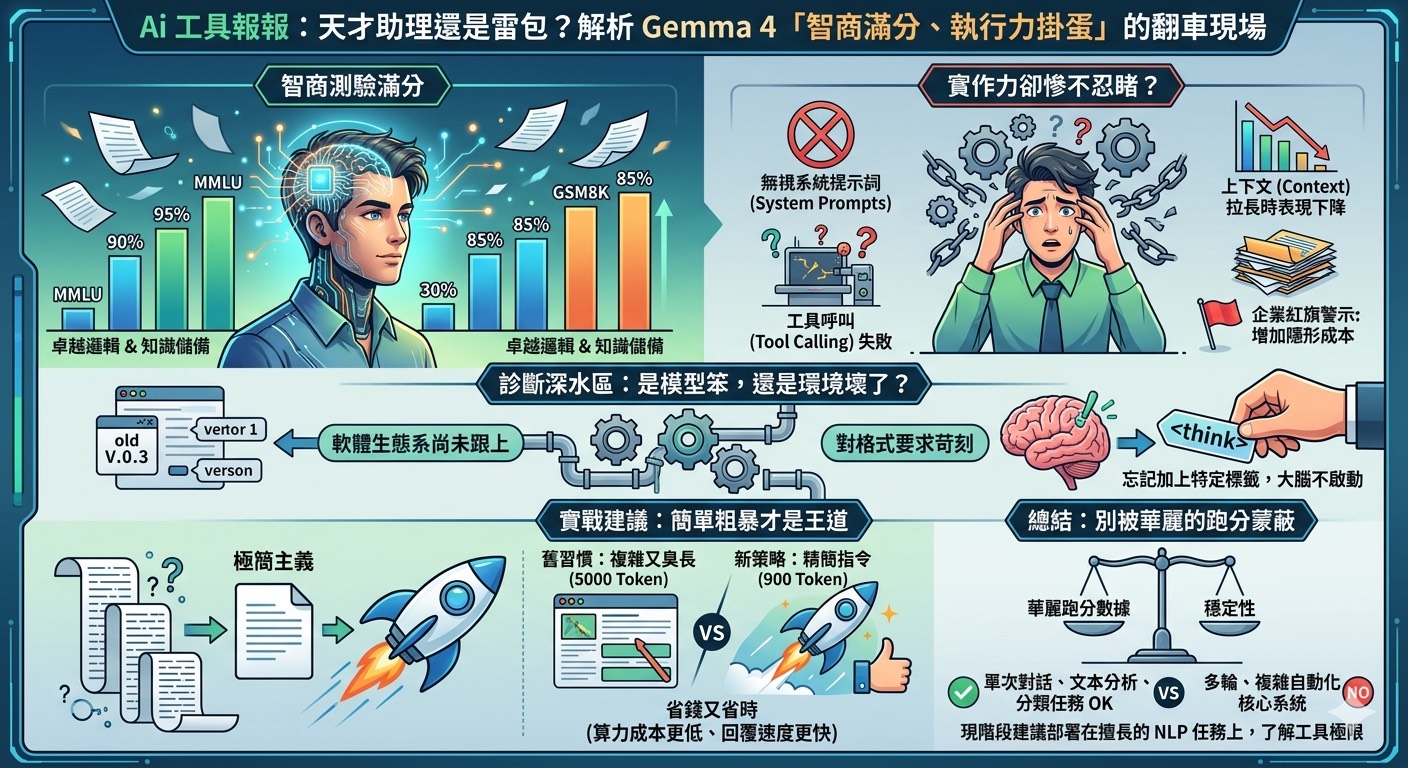

智商測驗滿分,實作力卻慘不忍睹?

從技術數據來看,Gemma 4 在標準的評測集(Benchmarks)上表現驚人,這代表它的底層邏輯與知識儲備確實達到了新高度。但在實際的「代理工作流」(Agentic Flows)中,開發者發現它存在嚴重的「指令無視」問題。它不僅會無視系統提示詞(System Prompts)設定的規則,甚至在需要呼叫外部工具(Tool Calling)來完成任務時,也經常按兵不動。

更致命的缺陷在於,當對話上下文(Context)拉長時,Gemma 4 的表現會直線下降,甚至陷入邏輯崩潰。這對於想要導入 AI 進行自動化客服或複雜專案管理的企業來說,無疑是個巨大的紅旗警示。畢竟,企業導入 AI 的初衷是為了省時省力,如果還需要額外派人去監督這個「天才助理」有沒有出包,反而增加了隱形成本。

診斷深水區:是模型笨,還是環境壞了?

然而,深入調查後發現,許多負評其實源於外圍軟體生態系尚未跟上 Gemma 4 的腳步。不少開發者仍在使用舊版的推論引擎(如舊版 llama.cpp)或是有瑕疵的量化模型,這就像是給一輛超跑加了劣質汽油,自然跑不動。

最令人哭笑不得的技術細節是,Gemma 4 對於格式的要求近乎苛刻。社群高手挖掘出,如果你希望啟動它的深度思考能力,必須在提示詞最前面加上特定的標籤(例如 <think>)。如果沒加,這顆「大腦」就不會啟動。許多資深工程師在論壇上罵了半天,最後才發現只是因為忘記在第一頁蓋上一個「請啟動大腦」的印章。

實戰建議:簡單粗暴才是王道

針對 Gemma 4 的獨特性格,目前的實戰策略應採取「極簡主義」。過去我們習慣將提示詞寫得又臭又長,試圖用嚴密的規則框住 AI,但這在 Gemma 4 身上適得其反。

有開發者實測,將原本 5000 個 Token 的複雜指令縮減至 900 個 Token 的精簡指令後,Gemma 4 的表現反而大幅提升,甚至超越了前代。這是因為新一代模型具備極強的直覺,過多的細節反而會稀釋它的注意力。對於企業主而言,這其實是個好消息:更短的指令代表消耗的算力成本更低,回覆速度更快,真正達到了「省錢又省時」。

別被華麗的跑分蒙蔽

Gemma 4 無疑是一個有天賦但脾氣古怪的藝術家。它在單次對話、文本分析與分類任務上能發揮極大價值,但若要讓它接管多輪、複雜的自動化核心系統,目前仍嫌不夠穩定。

在 AI 技術日新月異的時代,企業在選擇工具時,不應只迷信跑分數據。穩定性往往比偶爾的驚艷更重要。現階段,建議將 Gemma 4 部署在它最擅長的 NLP 任務上,而非強求它執行超長鏈結的工具呼叫。了解工具的極限,才能發揮它真正的商業價值。